Tabla de enlaces

-

Introducción

-

Trabajo relacionado

2.1 Diseño de logotipo tipográfico semántico

2.2 Modelo generativo para el diseño computacional

2.3 Herramienta de autoría de diseño gráfico

-

Estudio formativo

3.1 flujo de trabajo normal y desafíos

3.2 Preocupaciones en la participación generativa del modelo

3.3 Espacio de diseño del trabajo de tipografía semántica

-

Consideración de diseño

-

Típica y ideación 5.1

5.2 Selección

5.3 Generación

5.4 Evaluación

5.5 iteración

-

Tutorial de la interfaz y 6.1 etapa previa a la generación

6.2 Etapa de generación

6.3 Etapa posterior a la generación

-

Evaluación y comparación de referencia 7.1

7.2 Estudio de usuarios

7.3 Análisis de resultados

7.4 Limitación

-

Discusión

8.1 Diseño personalizado: colaboración consciente de la intención con AI

8.2 Incorporación del conocimiento de diseño en herramientas de soporte de creatividad

8.3 flujo de trabajo de diseño orientado a usuario de mezcla

-

Conclusión y referencias

5 Tipo de tipo

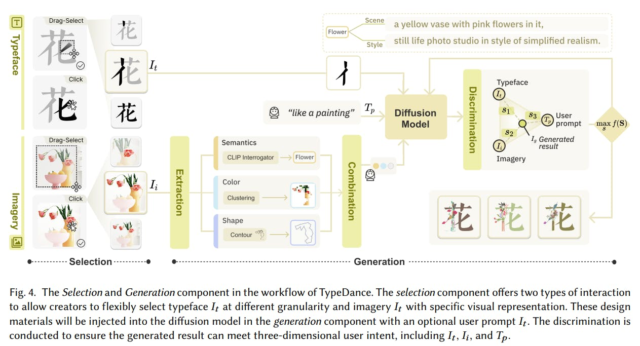

Según los fundamentos de diseño identificados y la oportunidad destacada para abordar los desafíos y las preocupaciones en el flujo de trabajo de diseño, hemos desarrollado Typedance, un sistema de autoría que facilita la generación personalizada para logotipos tipográficos semánticos. La tipedura comprende cinco componentes esenciales, que corresponden estrechamente a las etapas de pregeneración, generación y publish generación. En la etapa previa a la generación, el componente de ideación se comunica con el usuario para recopilar imágenes comprensibles (D1). El selección El componente permite al usuario elegir materiales de diseño específicos, incluida la letra de varias granularidades e imágenes con representaciones visuales particulares (D2). El generación componentes combinan estos materiales de diseño, utilizando una serie de antecedentes de diseño combinables (D3). Después de la generación, el evaluación El componente permite al usuario evaluar la posición del resultado precise en el espectro Tipo-Imagery (D4). El componente de iteración facule al usuario para refinar su diseño ajustando el espectro de la imagería tipo y editando cada elemento particular person (D5).

5.1 ideación

Gracias a las impresionantes capacidades de comprensión del lenguaje y razonamiento de modelos de idiomas grandes, ahora podemos colaborar con un cerebro bien informado a través del texto. Typedance aprovecha el instructo GPT-3 (Davinci-002) [36] con la provisión de la cadena de pensamiento [53] para generar imágenes relevantes basadas en textos dados. Para mejorar la comprensión del usuario, la estrategia de solicitud incluye el requisito de acompañar las imágenes con explicaciones en términos de diseño visible. Esto asegura que las respuestas proporcionadas sean más interpretables e informativas. Por ejemplo, cuando el usuario proporciona la palabra clave “Hawai“Typedance genera imágenes concretas como”Camisa de aloha,“”Hula bailarín,” y “Palmera.“Junto con estas palabras de imágenes, Typedance también proporciona explicaciones como “Simboliza la cultura vibrante y la forma tradicional de danza de Hawaii“Para el “Hula Dancer”. Al hacer este pequeño cambio, Typedance proporciona explicaciones interpretables y ofrece a los usuarios un conocimiento de fondo adicional para mejorar su comprensión.

5.2 Selección

La selección tiene como objetivo preparar materiales de diseño mezclados en la siguiente generación. Abarca dos componentes fundamentales: seleccionar tipografía 𝐼𝑡 a varias granularidades e imágenes 𝐼𝑖 con representaciones visuales particulares. Logramos la segmentación de alta fidelidad de grano fino basada en el segmento cualquier modelo [25]que ofrece fácil de usar

indicaciones visuales como entrada, incluidos el cuadro y el punto. Como se ilustra en la Fig. 4, las diferentes características inherentes a los tipos de letra e imágenes dan lugar a diferentes interacciones que tienen como objetivo alinearse con los fundamentos de diseño.

Selección de tipografía. Dado el texto, Typedance permite a los creadores seleccionar tipos de letra 𝐼𝑡 con diferente granularidad, como se identifica en nuestro estudio formativo, para lograr un enfoque más de grano fino y versatile para las prácticas de diseño complejas. En lugar de limitarse al uso de trazos completos, Typedance permite a los creadores seleccionar regiones parciales de un solo trazo. Para lograr esto, como muestra la Fig. 4, implementamos la interacción de la selección de arrastre para que los creadores abarquen partes específicas del tipo de letra que necesitan dentro de una caja designada. En comparación con la interacción de clic, el Drag-Choose ofrece una forma más explícita de revelar la intención del usuario, que está libre de segmentación basada en reglas que está restringida por un conjunto de trazos predeterminados, lo que respalda la selección de grano más fino. Además, Typedance ofrece una selección de combinación por la cual los creadores pueden seleccionar trazos ubicados muy separados, como en el caso que se muestra en la figura 4.

Selección de imágenes. Con respecto a la selección de imágenes, empleamos segmentación semántica para extraer la representación visible que requieren los creadores de un fondo desordenado. Sin embargo, a diferencia de la selección de tipos de letra, la naturaleza de la selección de imágenes es más propicio para hacer clic en lugar de arrastrar la selección. Como se muestra en la Fig. 4, la selección de arrastre puede abarcar inadvertidamente otros objetos que el Creador puede no necesitar al seleccionar su objeto deseado. Para abordar este problema, hemos implementado una solución en la que los creadores pueden hacer clic en objetos individuales por separado, mitigando el problema de la cobertura de objetos no intencional. De manera comparable a la selección de tipos de tipos de tipos, también admite la selección de combinación, lo que permite a los creadores elegir múltiples objetos dentro de la imagen.

Autores:

(1) Shishi Xiao, Universidad de Ciencia y Tecnología de Hong Kong (Guangzhou), China;

(2) Liangwei Wang, Universidad de Ciencia y Tecnología de Hong Kong (Guangzhou), China;

(3) Xiaojuan MA, Universidad de Ciencia y Tecnología de Hong Kong, China;

(4) Wei Zeng, Universidad de Ciencia y Tecnología de Hong Kong (Guangzhou), China.

Este documento es