¿Es más grande siempre mejor en AI? Protocolo de coral desafía esa concept de frente

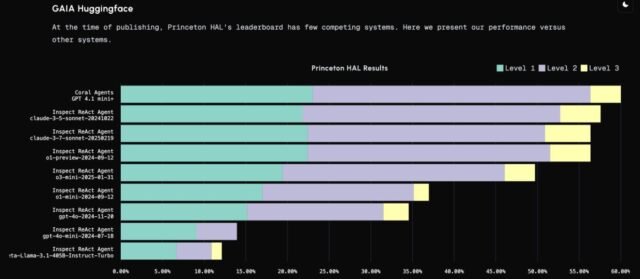

¿Por qué seguimos persiguiendo modelos cada vez más grandes en inteligencia synthetic? Esa es la pregunta que el protocolo de coral se propuso responder. En una prueba de rendimiento utilizando el punto de referencia de GAIA, el sistema de Coral superó a Magnetic-UI respaldado por Microsoft por un margen del 34 por ciento. No mediante la construcción de un modelo más grande, sino orquestando múltiples más pequeños, lo que la compañía llama escala horizontal.

El resultado es un desafío para la norma de larga knowledge del desarrollo de IA: agregar más parámetros para exprimir mejores resultados. El enfoque de Coral no se centra en el tamaño, sino en la función, la coordinación y la colaboración entre agentes especializados más pequeños.

¿Cuál es el punto de referencia de Gaia y por qué importa?

El Punto de referencia de Gaia es una de las pruebas más rigurosas en inteligencia synthetic. Evalúa los modelos de IA basados en su capacidad para resolver problemas complejos del mundo actual que requerirían un esfuerzo humano calificado. El punto de referencia incluye 450 tareas no triviales como:

- Investigación y síntesis

- Análisis de datos

- Planificación y resolución de problemas

- Generación de respuestas

- Interpretación visible y de video

A diferencia de los puntos de referencia como MMLU o GSM8K, que prueban los conocimientos memorizados o los rompecabezas lógicos, Gaia está diseñado para simular la asistencia de IA de uso common. Esto lo convierte en una métrica más útil para evaluar la utilidad del mundo actual de los agentes basados en LLM.

Cuando Coral encabezó las listas de Gaia para mini modelos, validó una escuela de pensamiento alternativa. En lugar de construir un solo modelo grande, Coral apiló múltiples agentes más pequeños en un sistema coordinado para lograr más con menos.

¿Qué es el protocolo de coral?

El protocolo de coral es una infraestructura de código abierto que permite una colaboración inteligente entre pequeños agentes de IA especializados. En lugar de ampliar un solo modelo grande, Coral distribuye inteligencia en múltiples modelos más pequeños utilizando un sistema de coordinación de múltiples agentes. Esto hace que la IA sea más eficiente, más adaptable y menor en costo.

Está diseñado para respaldar lo que llama el Web de los agentesdonde los desarrolladores pueden implementar agentes de IA que trabajan juntos en tiempo actual utilizando la arquitectura descentralizada de Coral.

Inside Coral’s Agentic System: cómo funciona realmente

En el corazón del sistema de Coral está su marco de múltiples agentesque aprovecha un protocolo descentralizado y abierto para orquestar tareas. En lugar de centralizar la inteligencia en un LLM monolítico, la configuración de Coral se asemeja a una malla colaborativa. A cada agente se le asigna una función específica, como responder, criticar, planificar, navegar o procesar imágenes y comunicarse con otros agentes que usan Coral’s MCP (Protocolo de comunicación de múltiples agentes).

Este diseño permite a Coral desplegar inteligencia enfocada, tarea por tarea, en todos los agentes. Los agentes trabajan en paralelo, aumentando la velocidad y la especialización sin requerir más parámetros en ningún modelo particular person.

La arquitectura está inspirada en marcos existentes como Búho de Camelpero Coral empuja la concept aún más descentralizando la coordinación e integrando la interoperabilidad como una característica central.

“Es una prueba de que la escala horizontal no solo es posible, es práctica”, dijo CarcasaCTO del protocolo de coral. “El Web de los Agentes ahora es una realidad que funciona”.

Por qué esto es importante para el futuro de la IA (y la apuesta de Nvidia por pequeños modelos)

La victoria de Coral no solo sacude las tablas de clasificación de la evaluación comparativa. Refuerza un cambio de industria más amplio: La tesis de nvidia de que los modelos pequeños son el futuro. Un reciente documento técnico de Nvidia argumentó que los modelos grandes están alcanzando retornos decrecientes, y el camino hacia adelante radica en orquestar modelos más pequeños, más rápidos y más especializados.

El resultado de referencia de Gaia de Coral coloca un peso práctico detrás de esa teoría. El equipo de coral no solo optimizó el rendimiento, demostraron que incluso mini modelos abiertos Puede superar a la infraestructura de IA respaldada por corporaciones cuando el sistema está bien diseñado.

Esto abre la puerta para que los desarrolladores de IA trabajen con recursos restringidos. Con el enfoque de Coral, uno no necesita el último modelo de parámetros 70B+ o GPU de mil millones de dólares para construir aplicaciones de IA de alto funcionamiento.

Microsoft, Magnetic-UI y la carrera para construir infraestructura de agente

Magnético-uiun sistema respaldado por Microsoft, fue anteriormente uno de los marcos principales creados para demostrar la interacción avanzada de usuario-AI a través de modelos grandes. Su enfoque se inclinó fuertemente en la escala vertical, modelos más grandes, más parámetros, más complejidad computacional.

La ventaja de rendimiento del 34 por ciento de Coral plantea preguntas sobre la sostenibilidad y la eficiencia de ese enfoque. Si los agentes más pequeños pueden hacer el trabajo mejor, más barato y más rápido, ¿por qué seguir construyendo más grande?

Los desarrolladores de Coral están posicionando su protocolo como la infraestructura abierta para “Web de los agentes”. Las implicaciones son graves: los sistemas de IA podrían volverse descentralizados, liderados por desarrolladores y livianos, reduciendo los costos y la expansión de acceso más allá de los jardines amurallados de Large Tech.

Por qué este es un momento decisivo en el debate de escala de AI

El resultado del Protocolo de Coral no se trata solo de vencer a Microsoft en una prueba. Se trata Cambiando la narrativa de escala en ai por completo. Durante años, la concept dominante ha sido: cuanto más grande sea el modelo, mejores serán los resultados. Esa creencia creó una alta barrera de entrada y consolidó el poder de IA en algunos jugadores centralizados.

Este resultado de referencia de Gaia, combinado con la investigación de Nvidia y la aparición de protocolos de coordinación abierta como Coral, señala un futuro donde AI escalas por distribución, no solo volumen.

Si los desarrolladores de código abierto pueden conectarse al protocolo de Coral, girar agentes especializados y superar los nombres más importantes de la industria, estamos entrando en una nueva fase en la evolución de la IA.

La clave es la interoperabilidad y la comunicación entre agentes inteligentes. No solo cerebros más grandes, sino sistemas más inteligentes.

** Cómo los desarrolladores pueden usar el protocolo de coral hoy

Si eres un desarrollador de agentes, puedes “Coralizar“Sus agentes que usan la infraestructura de Coral. Esto significa conectarse a su protocolo abierto para:

-

Orquestación de múltiples agentes

-

Comunicación segura utilizando MCP

-

Fideicomiso y pagos descentralizados

-

Arquitectura basada en gráficos para el descubrimiento y el enrutamiento de los agentes

Si está creando una aplicación, puede usar la infraestructura de Coral para ejecutar sistemas de IA ligeros y distribuidos sin depender de los costosos LLM.

Documentación: https://docs.coralprotocol.org/coralaldoc/introduction/whatiscoralprotocol

Pensamientos finales

Los sistemas de IA agente están evolucionando rápidamente, y la victoria de Coral en Gaia es una señal temprana de lo que está por venir. Muestra que los mini modelos, cuando están bien coordinados, son capaces de superar a los gigantes. También sugiere que La infraestructura de IA pronto priorizará la interconectividad y la orquestación sobre el tamaño bruto.

El ecosistema de código abierto debe tomar nota. La arquitectura de Coral podría servir como un plan para descentralizar el acceso a la IA, empoderar a los desarrolladores independientes y finalmente formar la infraestructura para AGI seguro.

¡No olvides que me gusta y compartir la historia!

Este autor es un contribuyente independiente que publica a través de nuestro